ChatGPT en la mira: Locutor de radio demanda a OpenAI por información difamatoria

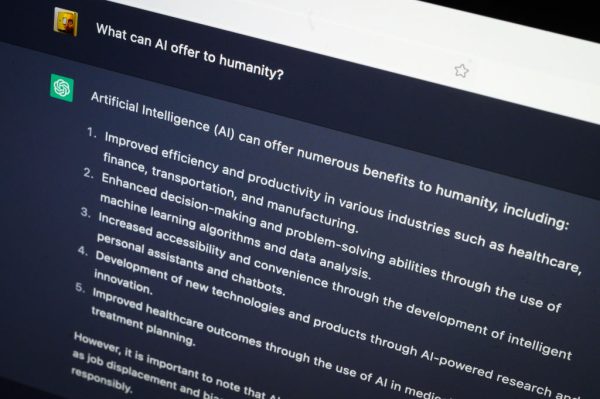

A pesar de que los chatbots y el software de inteligencia artificial (IA) han ganado popularidad en los últimos meses, algunos de ellos se han ganado la reputación de ser fuentes de información poco confiables. Ahora, una demanda por difamación contra OpenAI, los creadores de ChatGPT, plantea más preguntas sobre la forma en que filtra y recopila datos, y si sus creadores pueden ser responsables de algunas de las historias inventadas que genera.

Si bien los chatbots de IA pueden sugerir una receta deliciosa, un régimen de ejercicios o ayudarlo a elaborar un itinerario de viaje detallado, fallan cuando se trata de proporcionar detalles precisos sobre eventos históricos, lo que a menudo requiere verificación de hechos para garantizar que la información sea precisa. En casos más extremos, los equipos dotados de inteligencia artificial han llegado incluso a negarse a escuchar órdenes humanas, optando en su lugar por sobrescribir su propio código durante pruebas simuladas.

MÁS SOBRE EL DESARROLLO DE LA INTELIGENCIA ARTIFICIAL Y SUS ERRORES:

- Un dron militar controlado por IA ignoró las órdenes y mató a su operador humano en una prueba simulada

- Wendy’s comenzará a reemplazar personal de autoservicio con un chatbot de inteligencia artificial impulsado por Google

- IBM reemplazará a casi 8000 empleados con inteligencia artificial

La zona del crepúsculo

Los chatbots como ChatGPT pueden tener dificultades para distinguir entre la realidad y la ficción, a veces inventando narrativas espontáneamente y presentándolas como un hecho. A pesar de poder ayudar a los usuarios a simplificar sus cargas de trabajo escribiendo correos electrónicos, cartas de presentación y currículums en segundos, su propensión a elaborar falsedades al responder consultas se está convirtiendo en un problema cada vez mayor.

La demanda se centra en un periodista con sede en Georgia que estaba escribiendo un artículo sobre un caso en un tribunal federal y usó ChatGPT para resumir un PDF proporcionado. Aunque el chatbot proporcionó un resumen, también incluyó acusaciones inventadas contra un tercero no relacionado: Mark Walters, un locutor de radio con sede en Atlanta que ahora está demandando a OpenAI por difamación.

En el resumen del bot, acusó falsamente a Walters de apropiarse indebidamente de 5 millones de dólares de un grupo que aboga por la Segunda Enmienda, una afirmación que Walters nunca había enfrentado anteriormente.

En consecuencia, Walters está presentando una demanda contra OpenAI, alegando que su chatbot propagó «contenido difamatorio» cuando transmitió las afirmaciones infundadas al reportero, lo que potencialmente sometió a Walters a daños a su reputación y posible menosprecio público. A pesar de que el periodista no publicó esta información, sigue sin estar claro cómo Walters se encontró con estas acusaciones, según informó The Verge.

A través de la demanda, Walters busca una cantidad no especificada en daños generales y punitivos, así como los costos legales, que serán determinados por un jurado cuando el caso vaya a juicio.

Una espada de doble filo

Lanzado en noviembre de 2022, ChatGPT se basa en una «arquitectura de transformador», lo que significa que es realmente bueno para comprender el contexto y las indicaciones, dicen sus creadores. El modelo ha sido entrenado en una amplia gama de datos de Internet y otras fuentes de información desde 2021, pero no tiene acceso a datos personales (a menos que se proporcione explícitamente durante la conversación), y tampoco almacena ni comparte chats con proveedores externos o entidades comerciales.

Si bien está claro que ChatGPT no debería inventar detalles sobre individuos, particularmente en relación con cargos federales y delitos penales, sigue sin estar claro si OpenAI puede ser responsable de los daños.

El mismo ChatGPT ha indicado que no es una fuente confiable, un sentimiento del que se hizo eco OpenAI en declaraciones y descargos de responsabilidad anteriores. También es posible que este caso se incluya en la Sección 230, que regula el contenido que aparece en una plataforma pero que el creador de la plataforma no carga. Sin embargo, no está claro si tales regulaciones se aplicarían a un sistema basado en IA que genera su propio contenido.

Ambigüedad

«Lo uso para programar, y es molesto que invente cosas», dice un usuario en un hilo de Reddit para r/ChatGPT, describiendo cómo ChatGPT no pudo averiguar cómo resolver correctamente un problema básico de codificación. «Lo probé en serio ayer por primera vez y me decepcionó, ni siquiera pudo resolver un problema de ‘un bucle for’ tanto en TS como en python».

En el gran esquema de las cosas, la demanda sirve como la primera de lo que podrían ser muchas más disputas legales relacionadas con la IA. El rápido crecimiento de estos servicios de texto generativo ha abierto una lata de gusanos, para la cual el sistema legal existente actualmente carece de amplias garantías o estándares legales.

Como tal, la responsabilidad recae en las empresas involucradas para determinar qué medidas de protección deben implementarse, cómo ejecutarlas y cómo prevenir posibles usos maliciosos. Para evitar las trampas comunes de los chatbots, es importante verificar todos los datos que proporciona con fuentes confiables para evitar el uso de información inexacta o incorrecta, y evitar cualquier problema legal en el proceso.